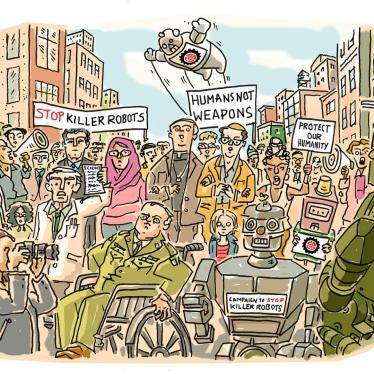

Genève, le 27 août 2018 - Alors que la 6ème réunion internationale sur les systèmes d’armes létales autonomes (SALA) s’ouvre aujourd’hui à l’Office des Nations-Unies à Genève, les appels se multiplient pour que les Etats s’engagent à interdire les armes autonomes ou robots tueurs. Ces systèmes, une fois activés, peuvent sélectionner et attaquer des cibles sans intervention humaine. La Campagne contre les robots tueurs rappelle les risques moraux, juridiques et sécuritaires de telles armes et engage les Etats à entamer sans délai des négociations pour qu’un traité d’interdiction juridiquement contraignant soit adopté d’ici fin 2019.

« Il est de plus en plus évident que l’opinion publique est fortement opposée à l’idée que des machines sélectionnent et fassent usage de la force sans aucun contrôle humain significatif. C’est une évolution immorale et un affront à la dignité humaine et aux principes d’humanité » rappelle Jody Williams, prix Nobel de la paix 1997 et présidente de la Nobel Women’s Initiative.

A ce jour, 26 Etats se sont prononcés pour l’interdiction des SALA, dont la Chine, l’Autriche, la Colombie ou Djibouti. Le 4 juillet dernier, le Parlement belge a adopté une résolution soutenant l’interdiction de l’usage de ces armes et s’engageant à ce que l’armée belge ne les utilise pas. Des milliers d’experts de l’intelligence artificielle et des centaines d’entreprises en robotique et technologie ont également signé une déclaration dans laquelle ils s’engagent à ne pas participer à la conception, au développement ou à la commercialisation des armes létales autonomes. Le 7 juin dernier, Google a adopté des principes éthiques lui interdisant de concevoir ou développer l’intelligence artificielle pour des armements. Dans son Agenda pour le désarmement de mai 2018, le Secrétaire général des Nations-Unies proposait aux Etats de les soutenir dans l’élaboration d’« arrangements juridiques contraignants » pour s’assurer que « les humains conservent à tout moment le contrôle de l’usage de la force ».

Plus de 70 pays sont attendus à la 6ème réunion sur les SALA, dans le cadre de la Convention sur certaines armes classiques (CCAC), du 27 au 31 août à Genève. Ils devront proposer des recommandations sur la suite de leur travail sur ce sujet. La CCAC fonctionne par consensus et un seul Etat peut s’opposer et potentiellement bloquer le début des négociations pour un nouveau traité.

Malgré l’importance des problèmes légaux, juridiques et moraux et les risques en termes de prolifération que posent les SALA, les Etats ne se sont pas encore accordés sur la réponse règlementaire à y apporter.

L’Autriche et d’autres Etats proposent l’ouverture de négociations d’un nouveau traité pour garantir le maintien d’un contrôle humain suffisant sur les systèmes d’armement. Cela pourrait aboutir à l’adoption d’un nouveau protocole à la CCAC[1].

Côté français, si le Président Emmanuel Macron s’est déclaré « catégoriquement opposé » aux armes létales autonomes, les diplomates proposent aujourd’hui l’adoption d’une simple déclaration politique non-contraignante sur le sujet.

« Une dynamique est en train de se construire rapidement pour que les Etats commencent à négocier un traité d’interdiction et déterminent ce qui est nécessaire pour maintenir un contrôle humain sur les systèmes d’armements et l’usage de la force », explique Peter Asaro, vice-président de l’International Committee for Robots Arms Control (ICRAC). « Demander plus de temps pour étudier les enjeux de ce type d’armes pourrait sembler justifié, mais semble de plus en plus être une excuse pour retarder l’inévitable règlementation qui doit être adoptée. »

La France, les Etats-Unis, le Royaume Uni, Israël ou la Russie rejettent l’idée de négocier une nouvelle législation internationale sur les SALA. Ces puissances militaires investissent massivement dans les drones armés et autres systèmes avec des niveaux de contrôle humain réduits. L’inquiétude réside dans le fait que les progrès des capteurs et de l’intelligence artificielle rendent de plus en plus réelle la possibilité de créer une arme intervenant sans contrôle humain. Si cette tendance se poursuit, les humains pourraient disparaître du circuit décisionnel, ne gardant qu’un rôle de supervision ou de programmation de paramètres de missions.

Pour Mary Wareham de Human Rights Watch, coordinatrice de la campagne contre les robots tueurs, « une déclaration de principe et des promesses sur la transparence ne sont pas suffisantes pour répondre au défi que représente la création d’armes autonomes. Seul un traité d’interdiction peut effectivement restreindre le développement de l’autonomie de fonctions essentielles des systèmes d’armement et éviter la déshumanisation de l’usage de la force. »

[1]A l’heure actuelle, la CCAC comporte cinq protocoles règlementant diverses armes dont les armes incendiaires, les restes explosifs de guerre ou les lasers aveuglants

#Armes #ONU: Il faut négocier un traité d’interdiction des armes létales autonomes #robotstueurs >> https://t.co/7PpMebnc7l @BanKillerRobots

— HRW en français (@hrw_fr) 27 août 2018

[Tribune] «Robots tueurs» : la France doit soutenir leur interdiction

— Libération Idées (@LibeIdees) November 20, 2018

Par @BenJeannerod (@hrw_fr) @asimpere (@BanKillerRobots) @t_fortinhttps://t.co/HZo2Y6NeUb via @libe