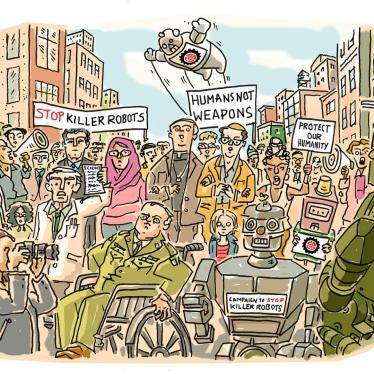

(Genève) – En vertu des lois de l’humanité et des exigences de la conscience publique, les armes entièrement autonomes devraient être interdites, a déclaré Human Rights Watch dans un rapport rendu public aujourd’hui. Les pays qui participeront à une réunion internationale sur ces « robots tueurs » devraient convenir de négocier une interdiction du développement, de la production et de l’utilisation de ces systèmes d’armement.

L’interdiction des robots tueurs, un impératif moral et juridique

Le rapport de 46 pages, intitulé « Heed the Call: A Moral and Legal Imperative to Ban Killer Robots » (« Répondez à l’appel : l’impératif moral et juridique d’interdire les robots tueurs »), conclut que les armes entièrement autonomes violeraient ce que l’on appelle la Clause de Martens. Cette disposition de longue date du droit international humanitaire exige que les technologies émergentes soient jugées sur la base des « lois de l’humanité » et des « exigences de la conscience publique » lorsqu’elles ne sont pas déjà couvertes par les dispositions d’autres traités.

« Autoriser le développement et l’utilisation des robots tueurs porterait atteinte aux normes morales et juridiques établies », a déclaré Bonnie Docherty, chercheuse senior auprès de la division Armes de Human Rights Watch, qui coordonne la Campagne pour mettre fin aux robots tueurs. « Les États devraient œuvrer de concert pour interdire à titre préventif ces systèmes d’armement avant leur prolifération à travers le monde. »

L’interdiction adoptée à titre préventif en 1995 des armes à laser aveuglantes, qui répondait en grande partie aux préoccupations soulevées par la clause de Martens, constitue un précédent pour interdire les armes entièrement autonomes, alors qu’elles sont sur le point de devenir une réalité.

Le rapport a été publié conjointement avec la Clinique internationale des droits de l’homme de l’école de droit de Harvard, où Bonnie Docherty est directrice associée des conflits armés et de la protection des civils.

Du 27 au 31 août 2018, pour la sixième fois depuis 2014, plus de 70 gouvernements se réuniront au Palais des Nations à Genève pour se pencher sur les défis posés par les armes entièrement autonomes, également connues sous le nom de systèmes d’armement létaux autonomes. Les discussions, qui se déroulent au titre de la Convention sur certaines armes classiques, un important traité en matière de désarmement, ont été officialisées en 2017, mais manquent encore toutefois d’un objectif spécifique.

Human Rights Watch et la Campagne pour mettre fin aux robots tueurs appellent les États parties à la Convention à convenir d’entamer en 2019 des négociations en vue d’un nouveau traité qui imposerait un contrôle humain significatif sur ces systèmes d’armement et sur le recours à la force. Des armes entièrement autonomes sélectionneraient et attaqueraient des cibles sans recourir à un contrôle humain significatif.

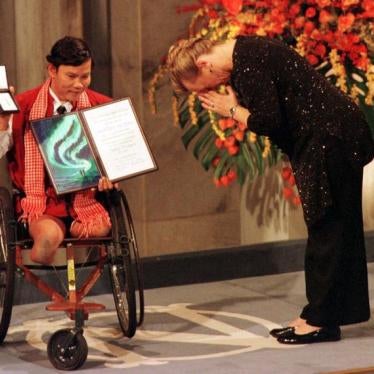

À ce jour, 26 pays ont explicitement soutenu l’interdiction des armes entièrement autonomes. Des milliers de scientifiques et d’experts dans le domaine de l’intelligence artificielle, plus de 20 lauréats du prix Nobel de la paix et plus de 160 leaders religieux et organisations confessionnelles diverses en ont également demandé l’interdiction. En juin, Google a publié un ensemble de principes éthiques comprenant un engagement à ne pas développer d’intelligence artificielle pour la fabrication d’armes.

Lors de réunions des États parties à la Convention sur certaines armes classiques, la quasi-totalité des pays ont appelé à maintenir une forme de contrôle humain sur l’usage de la force. L’émergence d’un consensus sur la préservation d’un contrôle humain significatif, qui équivaut en pratique à interdire les armes dépourvues d’un tel contrôle, reflète l’opposition largement répandue aux armes entièrement autonomes.

Human Rights Watch et la Clinique de Harvard ont évalué les armes entièrement autonomes à l’aune des principes fondamentaux de la clause de Martens. Cette clause, incluse dans les Conventions de Genève, et mentionnée dans plusieurs traités de désarmement, est activée en l’absence de dispositions pertinentes dans les traités internationaux spécifiques sur la question. Elle fixe des principes moraux de base à l’encadrement de ces armes émergentes.

Diverses organisations ont constaté que des armes entièrement autonomes porteraient atteinte aux lois de l’humanité, car de telles armes seraient par nature incapables de compassion ou d’exercer des jugements juridiques et éthiques nuancés lors des prises de décisions relatives à l’usage de la force létale. En l’absence de ces qualités humaines, les armes se heurteraient à des obstacles importants pour garantir le traitement humain d’autrui et le respect pour la vie et la dignité humaines.

Des armes totalement autonomes iraient également à l’encontre des exigences de la conscience publique. Les gouvernements, les experts et l’opinion publique ont largement condamné la disparition du contrôle humain lors du recours à la force.

Des mesures partielles, telles que des réglementations ou des déclarations politiques en deçà d’une interdiction juridiquement contraignante, ne permettraient pas d’éliminer les nombreux dangers que posent les armes entièrement autonomes. Outre le fait qu’elles violent la clause de Martens, ces armes posent d’autres problèmes juridiques, d’établissement des responsabilités, de sécurité et de technologie.

Dans des publications antérieures, Human Rights Watch et la clinique de Harvard ont identifié les défis que les armes entièrement autonomes présenteraient pour se conformer au droit international humanitaire et au droit international des droits humains, ont analysé les lacunes en matière de responsabilité pour les préjudices illicites causés par ces armes, et ont répondu aux critiques d’une interdiction préventive.

Les 26 pays ayant appelé à une interdiction sont les suivants : l’Algérie, l’Argentine, l’Autriche, la Bolivie, le Brésil, le Chili, la Chine (qui a seulement appelé à interdire l’usage de telles armes), la Colombie, le Costa Rica, Cuba, Djibouti, l’Équateur, l’Égypte, le Ghana, le Guatemala, l’Irak, le Mexique, le Nicaragua, le Pakistan, le Panama, le Pérou, l’État de Palestine, l’Ouganda, le Saint-Siège, le Venezuela et le Zimbabwe.

Lancée en 2013, la Campagne pour mettre fin aux robots tueurs est une coalition de 75 organisations non gouvernementales de 32 pays, qui s’emploie à interdire à titre préventif le développement, la production et l’utilisation d’armes entièrement autonomes. Le 28 août, au Palais des Nations à Genève, Bonnie Docherty présentera le rapport aux délégations des États parties à la Convention sur certaines armes classiques lors d’une séance d’information de la Campagne pour mettre fin aux robots tueurs.

« La vague d’opposition parmi les scientifiques, les leaders religieux, les entreprises technologiques, les organisations non gouvernementales et les citoyens ordinaires démontre que le grand public est conscient que les robots tueurs outrepassent un seuil moral », a conclu Bonnie Docherty. « Leurs préoccupations, partagées par de nombreux gouvernements, méritent une réponse immédiate. »

--------------------

Tweets

Armes autonomes : les graves risques liés aux "robots tueurs" soulignés dans un nouveau rapport de HRW. https://t.co/pnkMe3PGxh

— HRW en français (@hrw_fr) 21 août 2018

Halte aux "robots tueurs" : Courte vidéo soulignant les dangers posés par ces armes autonomes https://t.co/QR227OEwTA (s/titres FR) #CCWUN

— HRW en français (@hrw_fr) 21 août 2018

Nov. 2018

Débat le 7 novembre organisé à Paris par @fsc_infos et la campagne @BanKillerRobots (incluant @hrw_fr) sur les robots tueurs. L'Observatoire des armements y participe. Venez nombreux ! pic.twitter.com/bxNFJ1BTGO

— Obsarm (@obsarm) October 31, 2018

Le @ParisPeaceForum a pour vocation de promouvoir la paix et la sécurité - Le développement

— HRW en français (@hrw_fr) 7 novembre 2018

des robots tueurs est un défi pour la paix et nous espérons que la France soutiendra activement une solution multilatérale pour y répondre #ParisPeaceForum

>> https://t.co/ZSqGs6PZeU pic.twitter.com/3iaUrU00JO

Déléguer à machine ou à algorithme décision de vie ou de mort sur un être humain est terrifiant, immoral et dangereux.

— HRW en français (@hrw_fr) 7 novembre 2018

France doit clairement s’opposer au développement des robots tueurs et soutenir un traité d’interdiction https://t.co/yGPbvY5pSu…#StopKillerRobots pic.twitter.com/kaYhA0Vq8b

[Tribune] «Robots tueurs» : la France doit soutenir leur interdiction

— Libération Idées (@LibeIdees) November 20, 2018

Par @BenJeannerod (@hrw_fr) @asimpere (@BanKillerRobots) @t_fortinhttps://t.co/HZo2Y6NeUb via @libe