(Ginebra) – Los valores básicos de la humanidad y la conciencia pública apoyan la prohibición de las armas totalmente autónomas, dijo Human Rights Watch en un informe publicado hoy. Los países que participan en la reunión internacional que se celebrará próximamente sobre dichos “robots asesinos” deberían acordar negociar una prohibición sobre el desarrollo, la producción y el uso de estos sistemas de armamentos.

Un imperativo moral y legal prohibir los robots asesinos

El informe de 46 páginas, Heed the Call: A Moral and Legal Imperative to Ban Killer Robots (“Atiendan la petición: es imperativo moral y legalmente prohibir los robots asesinos”), concluye que las armas totalmente autónomas violarían lo que se conoce como la Cláusula Martens. Esta antigua disposición del derecho internacional humanitario requiere que las tecnologías emergentes sean juzgadas según los “principios de la humanidad” y los “dictados de la conciencia pública” cuando no estén ya cubiertas por otras disposiciones de los tratados.

“Permitir el desarrollo y uso de robots asesinos quebrantaría las normas morales y legales ya establecidas”, dijo Bonnie Docherty, investigadora principal de armas de Human Rights Watch, que coordina la Campaña contra los Robots de Combate. “Los países deberían trabajar juntos para prohibir de forma preventiva estos sistemas de armas antes de que proliferen en todo el mundo”.

La prohibición preventiva en 1995 de los láseres cegadores, motivada en gran parte por las preocupaciones bajo la Cláusula Martens, proporciona un precedente para prohibir las armas totalmente autónomas conforme su uso se acerca a una realidad cada vez más inminente.

El informe fue publicado conjuntamente con la Clínica Internacional de Derechos Humanos de la Facultad de Derecho de la Universidad de Harvard, para la cual Docherty es directora asociada de conflicto armado y protección civil.

Más de 70 gobiernos se reunirán en la sede de Naciones Unidas en Ginebra del 27 al 31 de agosto de 2018 para su sexto encuentro desde 2014, en el que se abordarán los desafíos planteados por las armas totalmente autónomas, también conocidas como sistemas letales de armas autónomas. Las conversaciones en el marco de la Convención sobre Ciertas Armas Convencionales (CCAC), un importante tratado de desarme, se formalizaron en 2017, pero todavía no están dirigidas hacia un objetivo específico.

Human Rights Watch y la Campaña contra los Robots de Combate (Campaign to Stop Killer Robots) instan a los Estados parte de la convención a acordar el inicio de las negociaciones en 2019 para un nuevo tratado que requeriría un significativo control humano sobre los sistemas de armas y el uso de la fuerza, dado que asume que las armas totalmente autónomas seleccionarían y atacarían objetivos sin un control humano significativo.

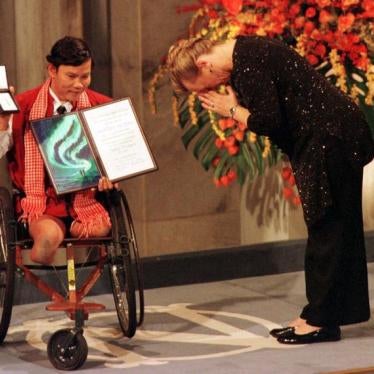

Hasta la fecha, 26 países han apoyado explícitamente la prohibición de las armas totalmente autónomas. Miles de científicos y expertos en inteligencia artificial, más de 20 Premios Nobel de la Paz y más de 160 líderes religiosos y organizaciones de diversas denominaciones también han exigido su prohibición. En junio, Google lanzó un conjunto de principios éticos que incluyen una promesa de no desarrollar inteligencia artificial para emplear en armas.

En las reuniones de la Convención sobre Armas Convencionales, casi todos los Estados han pedido que se mantenga algún tipo de control humano sobre el uso de la fuerza. El consenso emergente para preservar un control humano significativo, que es efectivamente equivalente a la prohibición de armas que carecen de ese control, refleja la oposición generalizada a las armas totalmente autónomas.

Human Rights Watch y la clínica de Harvard evaluaron armas completamente autónomas bajo los elementos centrales de la Cláusula Martens. La cláusula, que aparece en los Convenios de Ginebra y se menciona en varios tratados de desarme, es desencadenada por la ausencia de disposiciones específicas en los tratados internacionales sobre un tema concreto. Fija una base moral para juzgar armamentos de reciente aparición.

Los grupos concluyeron que las armas completamente autónomas socavarían los principios de la humanidad, porque no podrían aplicar ni la compasión ni juicios matizados por cuestiones legales o éticas a las decisiones de recurrir a la fuerza letal. Sin estas cualidades humanas, las armas se enfrentarían a obstáculos importantes para garantizar el trato humano de los demás y mostrar respeto por la vida y la dignidad de las personas.

Las armas totalmente autónomas también contradirían los dictados de la conciencia pública. Los gobiernos, los expertos y el público en general han condenado ampliamente la pérdida del control humano sobre el uso de la fuerza.

Las medidas parciales, como las regulaciones o las declaraciones políticas que no equivalen a una prohibición jurídicamente vinculante, no eliminarían los numerosos peligros que plantean las armas totalmente autónomas. Además de violar la Cláusula Martens, las armas plantean otros problemas legales, de rendición de cuentas, de seguridad y tecnológicos.

En publicaciones anteriores, Human Rights Watch y la clínica de Harvard expusieron los desafíos que presentarían las armas totalmente autónomas para cumplir con el derecho internacional humanitario y el derecho internacional de los derechos humanos, analizaron la brecha en la rendición de cuentas por el daño ilegal causado por dichas armas y respondieron a los detractores de una prohibición preventiva.

Los 26 países que han exigido la prohibición son: Argelia, Argentina, Austria, Bolivia, Brasil, Chile, China (sólo uso), Colombia, Costa Rica, Cuba, Ecuador, Egipto, Ghana, Guatemala, Irak, México, Nicaragua, el Estado de Palestina, Pakistán, Panamá, Perú, Uganda, el Vaticano, Venezuela, Yibuti y Zimbabue.

La Campaña “Stop Killer Robots”, lanzada en 2013, es una coalición de 75 organizaciones no gubernamentales de 32 países cuyo objetivo es prohibir de forma preventiva el desarrollo, la producción y el uso de armas totalmente autónomas. Docherty presentará el informe en una sesión informativa de la Campaña “Stop Killer Robots” para los delegados de la CCAC programada para el 28 de agosto en la sede de Naciones Unidas en Ginebra.

“La oleada de oposición entre científicos, líderes religiosos, compañías tecnológicas, grupos no gubernamentales y ciudadanos en general muestra que el público entiende que los robots asesinos cruzan un umbral moral”, señaló Docherty. “Sus preocupaciones, compartidas por muchos gobiernos, merecen una respuesta inmediata”.