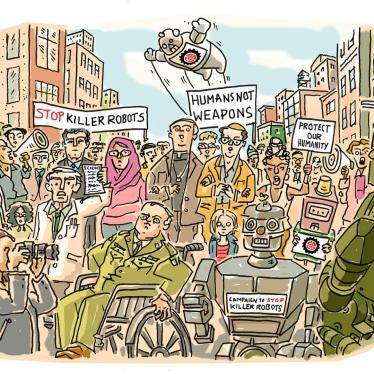

- Les gouvernements du monde devraient séparer les discussions en vue d’aboutir à un traité sur les systèmes d’armes létales autonomes, ou « robots tueurs », des réunions régulières relatives à un traité sur les armes déjà existant, où elles sont actuellement au point mort.

- Ces systèmes d’armes sont capables de fonctionner sans contrôle humain significatif, ce qui revient à déléguer des décisions de vie ou de mort à des machines. Plusieurs pays ont investi dans les technologies permettant de les mettre au point.

- Les gouvernements devraient entamer des négociations en vue d’un nouveau traité, soit en dehors du cadre de l’ONU, comme ils l’ont fait pour les traités sur les mines anti-personnel ou les armes à sous-munitions, soit au sein de l’Assemblée générale de l’ONU, comme pour le traité d'interdiction des armes nucléaires.

(Genève, le 10 novembre 2022) – Les discussions concernant l’élaboration d’un traité sur les systèmes d’armes létales autonomes (surnommées « robots tueurs ») étant actuellement bloquées, les gouvernements devraient les déplacer vers un nouveau forum international plus approprié, a déclaré Human Rights Watch dans un rapport publié aujourd’hui. Ces systèmes d’armes sont capables de fonctionner sans véritable contrôle humain, ce qui revient à déléguer des décisions de vie ou de mort à des machines.

Ce rapport de 40 pages, intitulé « An Agenda for Action : Alternative Processes for Negotiating a Killer Robots Treaty » ( « Un programme d’action : Des processus alternatifs pour la négociation d’un traité sur les robots tueurs » ), est publié conjointement par Human Rights Watch et par l’International Human Rights Clinic (Clinique du droit international des droits humains) de la faculté de droit de Harvard. Les deux organisations proposent que les pays s’engagent dans un processus d’élaboration d’un traité inspiré d’expériences passées d’accords de désarmement humanitaire, tels que le traité interdisant les armes à sous-munitions.

« Un nouveau traité international portant sur les systèmes d’armes autonomes nécessite un forum de négociations plus approprié », a déclaré Bonnie Docherty, chercheuse senior auprès de la division Armes de Human Rights Watch, directrice adjointe du programme Conflits armés et protection des civils à la Clinique du droit international des droits humains de Harvard, et auteure principale du rapport. « De nombreux précédents montrent qu’un processus alternatif pour créer des règles juridiques concernant les robots tueurs est viable et souhaitable, et les pays devraient agir dès maintenant pour ne pas se laisser dépasser par les évolutions technologiques. »

Plus de 70 pays, ainsi que des organisations non gouvernementales et le Comité international de la Croix-Rouge, considèrent l’adoption d’un nouveau traité comportant des interdictions et des restrictions comme nécessaire, urgent et réalisable. Le Secrétaire général des Nations Unies, António Guterres, a appelé à l’imposition de « limites convenues au niveau international » à des systèmes d’armes qui peuvent, d’eux-mêmes, cibler et attaquer des êtres humains, décrivant de telles armes comme « moralement révoltantes et politiquement inacceptables. »

Des pourparlers sur les inquiétudes suscitées par les systèmes d’armes létales autonomes sont en cours depuis 2014, sous les auspices de la Convention sur certaines armes classiques (CCAC). Les pays participants vont se rencontrer de nouveau au siège des Nations Unies à Genève du 16 au 18 novembre 2022, à l’occasion de la conférence annuelle d’examen du traité, mais rien ne permet d'indiquer qu’ils s’accorderont pour négocier un nouvel instrument juridiquement contraignant via la CCAC en 2023 ou dans un avenir proche.

La principale raison de l’absence de progrès dans le cadre de la CCAC est que ses pays membres ont privilégié une approche consensuelle des prises de décision, ce qui signifie qu’un seul pays peut faire échouer une proposition, même si tous les autres l’ont approuvée. Une poignée de grandes puissances militaires a à plusieurs reprises bloqué des propositions de passer du stade des discussions à celui des négociations, notamment l’Inde et la Russie au cours de l’année écoulée. Ces deux pays ont également tenté d’empêcher les organisations non gouvernementales de participer aux discussions en 2022.

L'Inde et la Russie, de même que l’Australie, la Chine, la Corée du Sud, les États-Unis, l’Iran, Israël, le Royaume-Uni et la Turquie, ont d’ores et déjà investi massivement dans les applications militaires de l’intelligence artificielle et des technologies connexes, afin de mettre au point des systèmes d’armes autonomes aériens, terrestres et navals.

Compte tenu des lacunes inhérentes au forum de la CCAC, d’autres processus de négociation d’un nouveau traité devraient être envisagés, ont déclaré Human Rights Watch et la Clinique des droits humains de Harvard. L’une des options possibles serait de lancer un processus indépendant hors du cadre de l’ONU, comme ce fut le cas pour les traités d’interdiction des mines antipersonnel et des armes à sous-munitions. Une autre serait de passer par l’Assemblée générale de l’ONU, forum qui avait lancé les négociations en vue du traité d’interdiction des armes nucléaires.

Ces processus alternatifs ont quatre caractéristiques qui les rendent particulièrement propices à l'adoption de traités robustes en temps opportun : un objectif commun ; une prise de décision reposant sur un vote ; des dates butoir claires et ambitieuses ; et un engagement en faveur de l'inclusivité, ont affirmé Human Rights Watch et la Clinique des droits humains de Harvard.

Des pays ont d’ores et déjà exprimé un large soutien à certains éléments essentiels nécessaires pour répondre aux préoccupations relatives à l’idée d’un abandon du contrôle humain de l’usage de la force. Un nouveau traité international devrait interdire les systèmes d’armes létales autonomes qui sont par essence dépourvus d’un contrôle humain significatif, ainsi que les systèmes qui ciblent des personnes. Il devrait contenir des obligations positives visant à assurer un véritable contrôle humain sur d’autres systèmes d’armes dotés d’une autonomie. L’expression « contrôle humain significatif » est communément entendu comme l’exigence d’une technologie compréhensible, prévisible et restreinte dans l’espace et dans le temps.

En octobre, 70 pays ont exprimé leur soutien à l’imposition « de règles et de limites convenues au niveau international » aux systèmes d’armes autonomes, dans une déclaration conjointe à la Première Commission de l’Assemblée générale de l’ONU chargée des questions de désarmement et de sécurité internationale.

On a également enregistré davantage d’expressions de soutien en faveur d’une règlementation de la part de l’industrie. En octobre, Boston Dynamics et cinq autres compagnies de robotique se sont engagées à ne pas transformer en armes leurs robots mobiles avancés et ont appelé les autres entreprises du secteur à « prendre l’engagement similaire de ne pas concevoir, autoriser, soutenir ou favoriser l’attachement d’armements à de tels robots. »

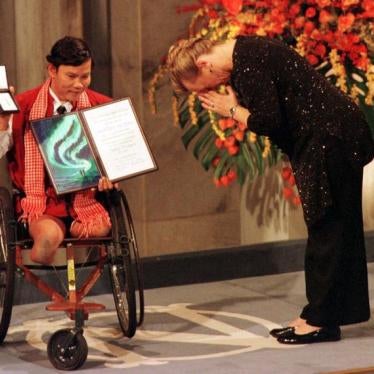

Human Rights Watch a cofondé la coalition Stop Killer Robots (« Stopper les robots tueurs »), qui rassemble plus de 190 organisations non gouvernementales dans 67 pays qui fait du plaidoyer pour une nouvelle loi internationale sur l’autonomie des systèmes d’armes.

« Plus la question des robots tueurs restera bloquée dans l’actuel forum de discussion, plus les entreprises mettant au point des systèmes d’armes autonomes auront de temps pour affiner de nouvelles technologies et parvenir à leur viabilité commerciale », a affirmé Bonnie Docherty. « Un nouveau traité serait d’une grande utilité pour endiguer cette course aux armements et éviter leur prolifération, en stigmatisant l’abandon du contrôle humain de ces armes. »

.............