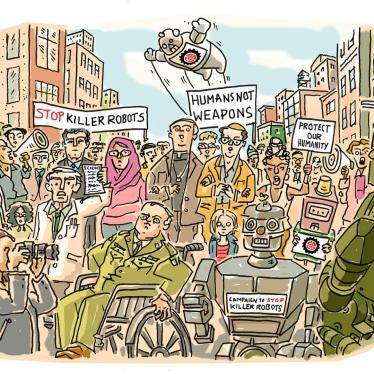

À surveiller en 2020 : le rejet international croissant des « robots tueurs » – ces armes capables de tuer en dehors de tout contrôle humain – et les appels de plus en plus pressants en faveur d’un nouveau traité visant à les interdire de manière préventive.

Si permettre à des armes de choisir et d’attaquer des cibles humaines sans l’intervention d’êtres humains ressemble à de la science-fiction, nous n'en sommes pourtant pas si loin. Des pays comme la Chine, Israël, la Corée du Sud, la Russie, le Royaume-Uni et les États-Unis développent et déploient déjà les précurseurs d’armes totalement autonomes, à l’instar des drones militaires qui peuvent être pilotés à distance par des êtres humains. Ces pays investissent massivement dans les applications militaires de l’intelligence artificielle (IA) pour prendre l’avantage dans le domaine technologique avec des outils nouvelle génération qui permettront de gagner en autonomie sur le champ de bataille.

Ces mêmes pays résistent aux appels de dizaines d’autres États qui réclament l’adoption d’un nouveau traité d’interdiction permettant un contrôle humain effectif sur le recours à la force. Ils jugent les efforts de réglementation des robots tueurs « prématurés » et rejettent les craintes selon lesquelles ces armes menacent le droit à la vie et les principes de la dignité humaine, ou qu’elles ne respectent pas les normes du droit international, notamment les principes de distinction, de proportionnalité et de nécessité militaire.

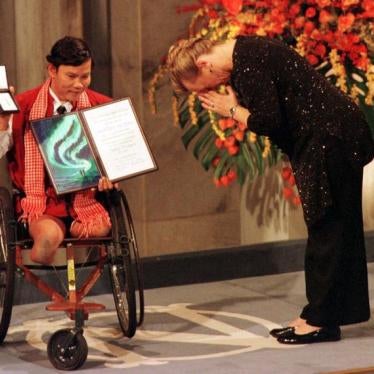

Mais le changement est en marche, alors même que les efforts de réglementation s’intensifient. Les robots tueurs sont désormais considérés comme l’une des principales menaces existentielles auxquelles notre planète doit aujourd’hui faire face. Soutenus par des alliés inattendus, un nombre croissant d’États sont favorables à un nouveau traité visant à interdire les systèmes d’armes létaux autonomes dont l’utilisation équivaudrait, selon plusieurs lauréats du prix Nobel de la paix, à franchir « un Rubicon moral et éthique ».

En septembre 2019, pendant l’Assemblée générale des Nations Unies, l’« Alliance pour le multilatéralisme », une initiative menée par la France et l’Allemagne et soutenue par des dizaines de ministres des affaires étrangères, a identifié les robots tueurs comme faisant partie des six questions « politiquement pertinentes » nécessitant une réponse multilatérale urgente. (Parmi les autres questions, on trouve notamment le changement climatique et l’égalité des sexes dans l'éducation).

Les huit réunions sur les robots tueurs organisées par la Convention sur certaines armes classiques (CCAC) depuis 2014 ont permis de dégager un large consensus parmi la quasi-totalité des 80 États participants sur la nécessité de conserver un certain degré de contrôle humain sur le recours à la force. Trente pays soutiennent désormais vigoureusement l’adoption d’un traité d’interdiction qu’ils jugent essentiel pour enrayer la suppression du contrôle humain sur les systèmes d’armes.

Le Secrétaire général de l’ONU, António Guterres, est également préoccupé par le fait que « des robots tueurs pourraient remplacer les soldats ». Jugeant la perspective de l’existence de machines dotées du pouvoir et de la discrétion de supprimer des vies humaines « politiquement inacceptable et moralement révoltante », il a lancé un appel pour l’adoption d’un nouveau traité et apporté le soutien de l’ONU à cet objectif, comme détaillé dans son Agenda pour le désarmement.

D’éminents experts en IA, des roboticiens, des scientifiques et des travailleurs du secteur des technologies chez Google et dans d’autres entreprises veulent une réglementation. Ils mettent en garde contre les algorithmes alimentés par des données qui reflètent inévitablement certains préjugés sociaux qui, s’ils sont appliqués aux armes, pourraient résulter en un ciblage disproportionné de certains profils de personnes. Les robots tueurs seraient aussi exposés au piratage et à des attaques qui, moyennant quelques modifications mineures de leurs données d’entrée, pourraient « les tromper là où aucun humain ne serait dupe ».

Les inquiétudes soulevées par les robots tueurs commencent également à avoir un impact sur leur acquisition et leur développement militaires ; les stratèges de défense sont de plus en plus nerveux et hésitent à budgétiser des millions de dollars pour développer des systèmes d’armes autonomes qui pourraient être interdits avant même d’être construits. En 2019, par exemple, une importante association industrielle allemande composée d’entreprises et de sous-traitants de la défense, dont Rheinmetall, a appelé le gouvernement à travailler à la rédaction d’un nouveau traité visant à interdire les robots tueurs.

Ceci démontre que la réglementation par un nouveau traité est le moyen le plus efficace de répondre à l’incertitude croissante sur ce qui peut ou ne peut pas être accepté en matière de systèmes d’armes autonomes dont la complexité ne cesse de se renforcer.

Sous la pression de l’opinion publique, les appels en faveur d’un nouveau traité d’interdiction des robots tueurs deviendront bientôt trop pressants pour les puissances militaires qui veulent y répondre au sein du seul forum défaillant du CCAC. Ne vous contentez pas de lire ce texte : rejoignez-nous au sein de la campagne Stopper les robots tueurs et exigez dès à présent l’adoption d’un traité d'interdiction.

--------------

En 2020, la nécessité d’un traité interdisant les #robotstueurs - ces armes autonomes pouvant tuer ou blesser sans véritable contrôle humain – est plus évidente que jamais, comme le souligne @marywareham @hrw. https://t.co/zSHxqhMIeJ @BanKillerRobots

— HRW en français (@hrw_fr) January 2, 2020

La campagne Stopper les #RobotsTueurs a reçu le prix de la paix de la ville d'Ypres. 90 % des personnes qui ont voté avaient moins de 18 ans Merci d'avoir voté Nous sommes honorés et nous continuerons à travailler pour un avenir plus sûr #KillerRobots https://t.co/BQZmGkTccD

— HRW en français (@hrw_fr) June 9, 2020