Man muss nicht gerade Expert*in sein, um das Problem der „Killerroboter“ zu verstehen. Maschinen, die - vielleicht durch einen Algorithmus - entscheiden, wer lebt und wer stirbt, sind an sich schon ziemlich gruselig.

Wir denken oft nur im Zusammenhang mit Kriegen an solche automatisierten Waffensysteme und wie sie auf dem Schlachtfeld eingesetzt werden könnten. Aber auch in Friedenszeiten stellt ihr Einsatz eine große Bedrohung dar.

Davor warnen uns Science-Fiction-Autor*innen schon seit Jahrzehnten.

Ray Bradbury zum Beispiel beschreibt in seinem 1950 erschienenen dystopischen Klassiker Fahrenheit 451 einen Schrecken namens „ Der mechanische Bluthund“ . Es handelt sich um eine achtbeinige, spinnenartige Maschine mit starken Sinnesrezeptoren und einer langen Nadel in der Schnauze, die mit Betäubungsmitteln gefüllt ist. Sie wird von der Polizei eingesetzt, um Menschen zu jagen und sogar zu töten, vor allem Andersdenkende, und wenn sie einmal losgelassen wird, läuft sie von alleine los.

Damals war es noch Science-Fiction, aber heute, ein dreiviertel Jahrhundert später, scheint die Technologie für den Bau einer solchen Bestie zu existieren. Da es immer wieder repressive Regierungen gibt, die nach neuen Wegen suchen, um ihren Willen durchzusetzen, und Technologieunternehmen, die von ihnen profitieren wollen, könnten also bald dystopische Hunde auftauchen. (siehe auch: Black Mirror Folge „Metalhead“)

Wie ein neuer Bericht von Human Rights Watch und der International Human Rights Clinic der Harvard Law School zeigt, ist die Zukunft bereits jetzt. Technologische Fortschritte und militärische Investitionen treiben heute die rasante Entwicklung von „Killerrobotern“ voran, die in mehrfacher Hinsicht die Menschenrechte bedrohen, darunter auch das Recht auf Leben.

Wir sprechen von autonomen Waffensystemen, die ohne nennenswerte menschliche Kontrolle funktionieren.

Nach ihrer Aktivierung würden sie sich auf Software verlassen, die oft Algorithmen, Daten von Sensoren wie Kameras, Radarsignaturen und Wärmebildern sowie andere Daten nutzt, um ein Ziel zu identifizieren. Nachdem sie ein Ziel gefunden haben, feuern sie oder geben ihre Nutzlast ab, ohne dass ein Mensch dies genehmigen oder überprüfen muss.

Das bedeutet, dass nicht ein Mensch, sondern eine Maschine entscheidet, wo, wann und gegen was Gewalt angewendet wird.

Bradburys nadelnasiger mechanischer Bluthund ist nur einer von tausend möglichen Schrecken.

Aber Bradbury war auch klar, warum er Science Fiction schreibt: „Die Leute verlangen von mir, dass ich die Zukunft vorhersage, obwohl ich sie nur verhindern will. Oder besser noch, sie zu schaffen."

Und die gute Nachricht ist, dass einige Regierungen genau das tun wollen: eine andere Zukunft schaffen.

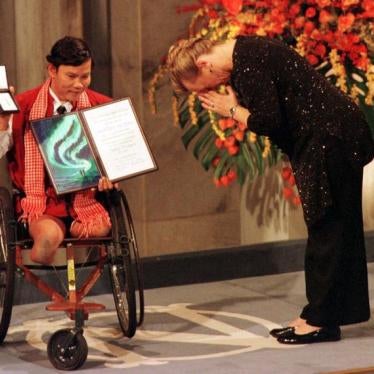

Im kommenden Monat wird die Generalversammlung der Vereinten Nationen zum ersten Mal über autonome Waffensysteme beraten. Sie folgt den Bemühungen von Kampagnen gegen Killerroboter und dem Aufruf von mehr als 120 Ländern, einen neuen internationalen Vertrag über autonome Waffensysteme zu verabschieden.

Ja, die Länder der Welt dazu zu bringen, sich auf etwas zu einigen, kann heutzutage ein bisschen wie das Hüten von Katzen sein. Aber die Bedrohung durch dystopische Hunde ist eine starke Motivation.