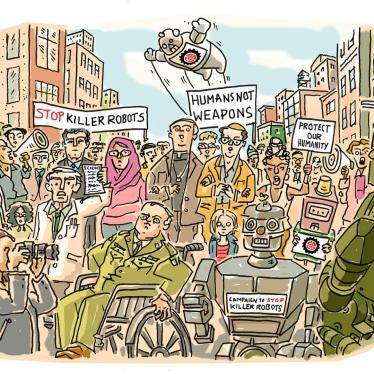

(Genève) – Les gouvernements devraient trouver le moyen d’étendre et de formaliser leurs délibérations internationales sur les armes totalement autonomes, avec pour objectif ultime de les interdire à titre préventif, a déclaré Human Rights Watch dans un rapport publié aujourd'hui. Ces armes, connues sous le nom de systèmes d'armes létales autonomes ou robots tueurs, seraient en mesure de sélectionner et d’attaquer des cibles en l’absence d’intervention humaine.

Intitulé « Un précédent pour la préemption » (« Precedent for Preemption: The Ban on Blinding Lasers as a Model for a Killer Robots Prohibition »), le rapport de 18 pages présente les raisons pour lesquelles les pays ont convenu, à titre préventif, d'interdire les armes à laser aveuglantes en 1995 et explique en quoi cette décision pourrait constituer un précédent aux efforts actuels visant à interdire les armes totalement autonomes. Les pays participant à la réunion annuelle de la Convention sur l'interdiction ou la limitation de l'emploi de certaines armes classiques (CCAC) décideront par consensus, le 13 novembre 2015, de poursuivre ou non l’an prochain leurs délibérations sur les systèmes d'armes létales autonomes.

« Les inquiétudes relatives aux armes totalement autonomes ont fait remonter cette question au sommet de l'ordre du jour international en matière de désarmement, mais les pays doivent accélérer le rythme de leurs discussions», a déclaré Bonnie Docherty, chercheuse senior auprès de la division Armes de Human Rights Watch, organisation cofondatrice de la Campagne Stop Killer Robots (« Stop aux robots tueurs »). « Les gouvernements peuvent maintenant agir directement en prenant l’engagement d'interdire les armes sans contrôle humain significatif sur la cible et le moment de l’attaque. »

Human Rights Watch, qui coordonne la campagne contre les robots tueurs, appelle les pays à s’engager dans un processus plus vigoureux grâce à la création d'un groupe d'experts gouvernementaux sur les armes totalement autonomes, en vertu de la CCAC.

Des experts en matière d’intelligence artificielle, des roboticiens et d'autres scientifiques prédisent que les armes totalement autonomes pourraient être mises au point dans un délai de quelques années. L'interdiction préemptive des lasers aveuglants, qui figure dans un protocole annexé au traité sur les armes conventionnelles, montre qu'une interdiction de ces futures armes est possible.

« La perspective d'armes totalement autonomes soulève les mêmes préoccupations que les lasers aveuglants il y a deux décennies », a déclaré Docherty, auteur principal du nouveau rapport retraçant l'histoire de l'interdiction des lasers qui rendent définitivement aveugles leurs victimes. « Les pays devraient parvenir à la même solution en prohibant les armes totalement autonomes avant qu'elles n’arrivent sur le champ de bataille ».

Le rapport conjoint de Human Rights Watch et du laboratoire des droits humains internationaux de l’Université de Harvard montre que les menaces aux principes d'humanité et d’exigence de conscience publique, ainsi que les notions d'horreur et d'inacceptabilité sociale, ont décidé les pays à interdire les lasers aveuglants. Les armes entièrement autonomes présentent des dangers similaires.

Le risque de prolifération généralisée des armes à laser aveuglant parmi des individus faisant peu de cas du droit international a été un autre facteur clé dans la décision des Etats, un risque auquel ont fait écho les discussions sur les armes totalement autonomes, selon Human Rights Watch et le laboratoire des droits humains internationaux de l’Université de Harvard. Comme avec les lasers aveuglants il y a 20 ans, une interdiction des armes totalement autonomes pourrait clarifier et renforcer la législation existante sans limiter le développement des technologies connexes légitimes.