19世纪末,各国外交官在起草战争法条约时,当然无法预见未来将发展出什么样的新武器。但他们设下了一套法律和道德标準,足以用来审查现行条约文字没有涵盖的新科技。

这套标準称为“马尔顿条款”(Martens Clause),经过国际人道法几度演进仍屹立不摇,在自主性武器将有能力自主决定何时对谁射击的今天更形重要。“马尔顿条款”呼吁,各国不得使用悖离“人道原则和公众良心支配”的武器。

我是人权观察和哈佛法学院国际人权诊所一份最近报告的主要作者,该报告说明为何全自主武器可能有悖人道原则和公众良心的支配。我们发现,为符合 “马尔顿条款”,各国应当通过条约,禁止这种武器的研发、生产和使用。

8月27到31日,将有70多国代表聚集在日内瓦联合国机构,商讨如何解决所谓的致命自主武器系统。这些国家都是《常规武器公约》缔约国,已经针对这一议题讨论五年。我和这份报告的共同作者都认为,时候已经到了,各国应采取行动,同意从明年展开禁止这种武器的谈判。

为未知制定规则

“马尔顿条款”是在缺乏具体条约法的情况下,保护平民和士兵的基準。根据该条款,也可以对前所未见的新情势与新科技加以评估。

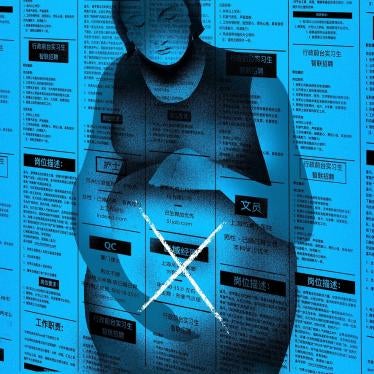

全自主武器,或称“杀手机器人”,可以在没有人类有效控制下选择交战目标。它比现有的武装无人机更加危险,因为它在决定目标和发动攻击时,不必经过人类操作。虽然全自主武器目前还未面世,但中国、以色列、俄罗斯、南韩、英国和美国都在著手研发。这些国家主张,用科技处理资讯比人更有效率,而且可以避免派士兵上战场。

既然全自主武器的出现已经指日可待,相关国家有必要依据“马尔顿条款”,考虑这种科技是否违背基本人道和公众良心。我们的研究发现,全自主武器从这两方面来看都有问题。

人道原则

由“马尔顿条款”的历史可以看出,它是国际人道法的基本原则。从首次出现在1899年《海牙公约》之後,它的一个版本成为所有《日内瓦公约》及其《第一附加议定书》的内容,并且得到许多裁军条约引用。1995年,各国曾基於“马尔顿条款”而通过对雷射致盲武器的预防性禁止规定。

人道原则要求以人的方式对待他人,尊重人的生命和尊严。全自主武器做不到这一点,因为它无法感到同情,也就是尽量避免造成他人痛苦和死亡的一种情感。这种武器也缺乏法律和伦理的判断力,因此无法在複杂和不可预测的衝突情境中保护平民。

此外,作为无生命的机器,这种武器无法真正理解人命的价值和丧失生命的严重性。它们的演算法会把人的生命化为数值。因为靠演算法做致命决策,它们会将瞄準镜前的人类──不论平民或士兵──简化为物体,无视他们的人性尊严。

公众良心的支配

反对全自主武器的声浪日益壮大,显示它也牴触公众良心的支配。许多国家的政府、专家和一般大众,通常基於道德考量,异口同声抗议未来武力可能脱逸於人类控制之外的问题。

迄今已有26国政府,包括中国,表态支持全自主武器禁令。大部分曾在联合国常规武器会议中发言的国家,都呼吁对武力的使用维持某种程度的人类有效控制。而这种要求,实际上和禁止不需人类扣扳机的武器并无二致。

数千名科学家和人工智慧专家也支持禁令,要求联合国采取行动,并在2018年7月发佈联名承诺,绝不协助研发或使用全自主武器。部分主要生产商已加入抵制。

160多位宗教领袖和20多位诺贝尔和平奖得主也同声谴责这种科技并支持禁令。多项国际和国内民意调查显示,多数民众对於全自主武器的研发和使用均表达反对意见。

“阻止杀人机器运动”是来自42个国家的75个非政府组织所组成的联盟,也是民间团体反对运动的主力。我所服务的人权观察是这个联盟的发起者之一,也是它的协调单位。

杀手机器人的其他问题

全自主武器不仅威胁人性和公众良心,还可能违反其他重要的国际法原则。它的应用将造成问责的漏洞,因为全自主机器人的行为不可预见,没有人会为它负起个人责任。

再说,杀手机器人出现後必将广泛扩散,并且引发军备竞赛。全自主武器可能被骇客入侵或带有技术缺陷的事实,使这种危险趋势更令人担忧。

为了说明禁令的必要性,我们对“马尔顿条款”进行分析,特别著重在授权机器自主决定生死是否违悖人性价值。我们的报告发现,武力的使用无论如何都必须经过人类有效控制。我们要求,在此次联合国会议中,各国应努力催生新的条约,避免人类遭遇缺乏人道判断或同情的致命攻击。明确禁止全自主武器,将可强化“马尔顿条款”所反映的国际人道法的长远道德与法律基础。