(Женева, 21 августа 2018 г.) – Элементарный гуманизм и общественное сознание требуют запрещения автономных оружейных систем, говорится в публикуемом сегодня докладе Хьюман Райтс Вотч. Участники предстоящего очередного раунда международных переговоров на эту тему должны договориться о том, чтобы начать процесс, который вел бы к полному запрещению разработки, производства и применения боевых роботов.

Запрет боевых роботов – это моральный и правовой императив

46-страничный доклад «Внять призыву. Запрет боевых роботов - это моральный и правовой императив» содержит вывод о том, что автономные оружейные системы входят в противоречие с давним принцип международного гуманитарного права предписывает оценивать новые военные технологии, если они пока не регламентированы писаными нормами, исходя из «законов человечности» и «требований общественного сознания» (см. ‘оговорку’ российского юриста-международника Федора Федоровича Мартенса).

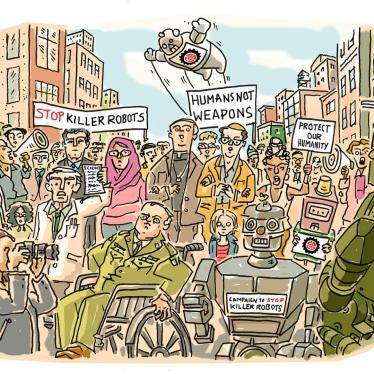

«Допустимость разработки и применения боевых роботов будет подрывать устоявшиеся принципы морали и права, - говорит Бонни Дочерти, старший исследователь по вопросам оружия Хьюман Райтс Вотч – координатора кампании «Остановить роботов-убийц». – Государства должны совместными усилиями добиться запрещения автономных оружейных систем до того, как это оружие широко распространится по миру».

Прецедентом для такого шага может служить упреждающий запрет ослепляющих лазеров в 1995 г., который в значительной степени был основан на оговорке Мартенса.

Доклад представляют совместно Хьюман Райтс Вотч и Международная клиника прав человека Гарвардской школы права, где Бонни Дочерти занимает пост заместителя директора по вопросам вооруженных конфликтов и защиты гражданского населения.

27-31 августа делегации более 70 государств соберутся во Дворце Наций в Женеве на шестую с 2014 г. встречу, посвященную автономным оружейным системам. Эти переговоры в рамках Конвенции по конкретным видам обычного оружия (Конвенции о «негуманном» оружии, КНО) были формализованы в 2017 г., однако пока они ведутся без привязки к конкретной цели.

Хьюман Райтс Вотч и кампания «Остановить роботов-убийц» настоятельно призывают участников КНО согласиться начать в 2019 г. переговоры о разработке нового договора, направленного на обеспечение содержательного контроля человека над оружейными системами и применением силы. Ключевая проблема с боевыми роботами заключается в том, что они будут выбирать и поражать цель без участия человека.

На сегодняшний день за запрещение автономных оружейных систем безоговорочно высказалась 26 государств, тысячи ученых и специалистов в области искусственного интеллекта, более 20 нобелевских лауреатов и более 160 религиозных лидеров и организаций, принадлежащих в самым разным конфессиям. В июне компания Google обнародовала свод этических принципов, в котором, среди прочего, обязалась не разрабатывать искусственный интеллект для оружейного использования.

На переговорах в рамках КНО почти все страны высказываются за сохранение человеком той или иной формы контроля за применением силы. Формирующийся консенсус по этому вопросу, который по сути означает поддержку запрета оружейных систем, такой контроль не предусматривающих, отражает нарастающее неприятие боевых роботов в мире.

В публикуемом докладе проводится оценка автономных оружейных систем с точки зрения оговорки Мартенса. Впервые появившаяся еще в Гаагских конвенциях и сохранившаяся в Женевских конвенциях 1949 г. и ряде других разоруженческих договоров, она применяется к ситуациям, когда тот или иной вопрос еще не урегулирован писаными нормами международного права, и – в данном случае – устанавливает нравственные критерии оценки оружия, которого раньше не существовало.

Авторы доклада считают, что автономные оружейные системы противоречат «законам человечности», поскольку они исключают сострадание или правовые/этические нюансы из принятия решения на поражение цели. Без этих человеческих «слабостей» оружейные системы едва ли окажутся способны проявлять гуманность и уважать жизнь и достоинство человека.

Автономные оружейные системы также входят в противоречие с «требованиями общественного сознания», поскольку по тем же основаниям вызывают широкое осуждение и со стороны правительств, экспертов и общественности.

Полумеры, такие как нормативное регулирование или политические декларации, не способны нейтрализовать множество рисков автономных оружейных систем. Их появление вызывает вопросы не только с точки зрения оговорки Мартенса, но и в части других правовых аспектов, ответственности, безопасности и технологии.

В своих предыдущих публикациях Хьюман Райтс Вотч и Гарвардская школа права рассматривали проблемы, которые автономные оружейные системы порождают для соблюдения норм международного гуманитарного права и прав человека, оценивали проблему ответственности за незаконное причинение вреда и вели полемику с противниками упреждающего запрета.

Идею запрещения автономных оружейных систем поддерживают 26 государств: Алжир, Аргентина, Австрия, Боливия, Бразилия, Чили, Китай (только в части применения), Колумбия, Коста-Рика, Куба, Джибути, Эквадор, Египет, Гана, Гватемала, Ватикан, Ирак, Мексика, Никарагуа, Пакистан, Панама, Перу, Государство Палестина, Уганда, Венесуэла, Зимбабве.

Начатая в 2013 г. кампания «Остановить роботов-убийц» объединяет 75 неправительственных организаций из 32 стран, которые выступают за упреждающее запрещение разработки, производства и применения автономных оружейных систем. Бонни Дочерти представит доклад на брифинге кампании для делегаций государств – участников КНО 28 августа во Дворце Наций в Женеве.

«Мощная волна отторжения, которую боевые роботы вызывают среди ученых, религиозных деятелей, разработчиков высоких технологий, неправительственных групп и простых граждан, свидетельствует об осознании обществом того факта, что автономные оружейные системы находятся за гранью морали, - говорит Бонни Дочерти. – Этот общественный запрос, который разделяют многие правительства, заслуживает безотлагательного реагирования».